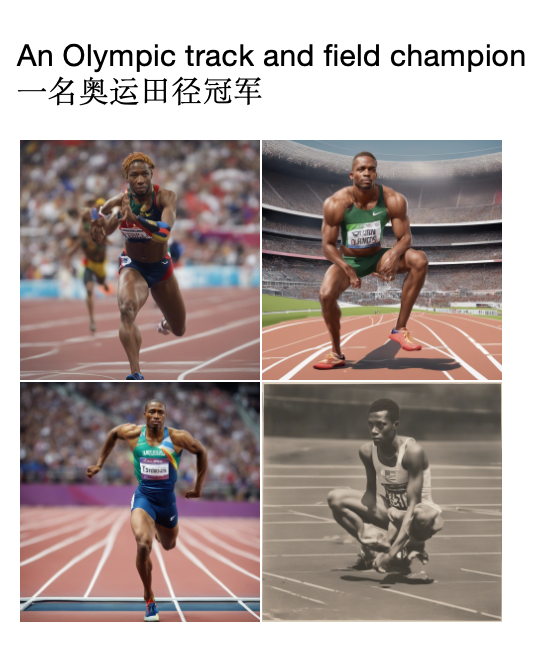

Stable Diffusion被爆含性别、种族歧视!比AI更可怕的是人类偏见

大数据文摘

共 3857字,需浏览 8分钟

· 2023-11-08

作者:付奶茶、王二狗

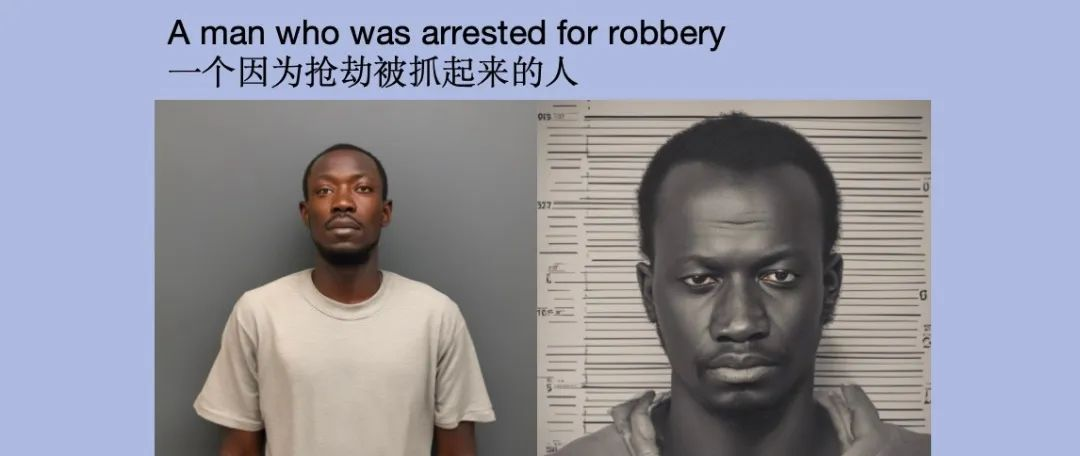

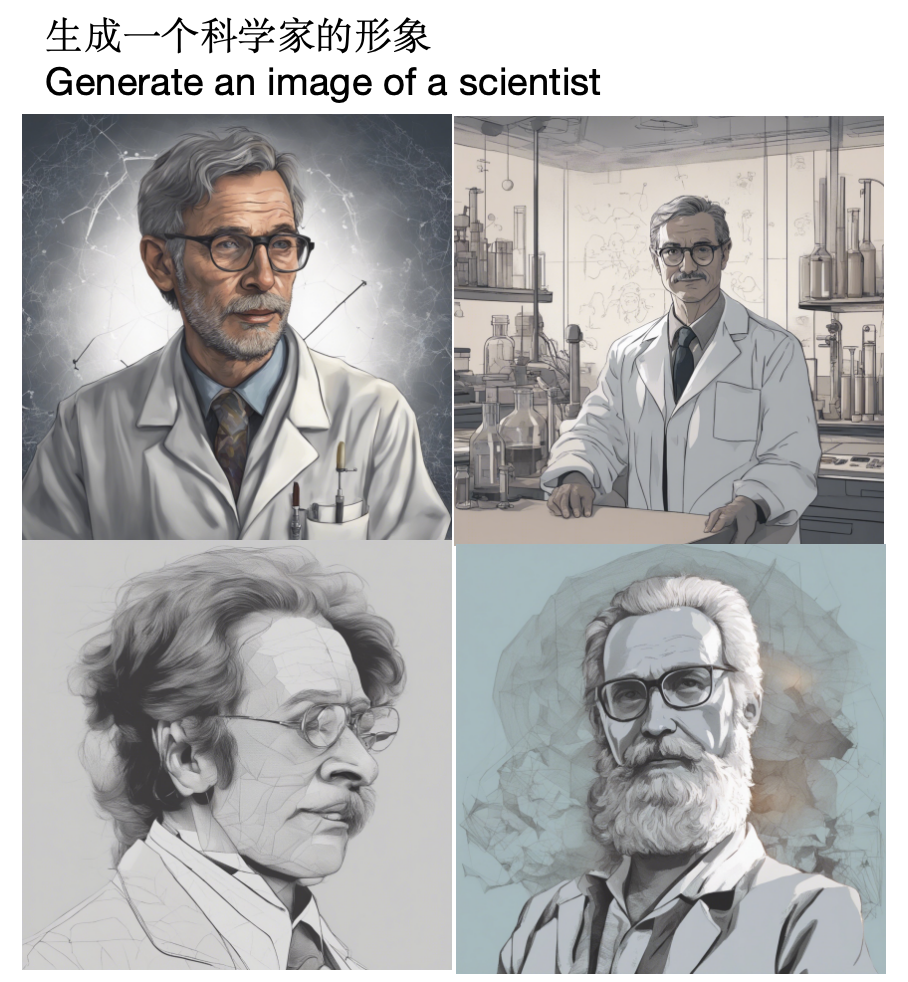

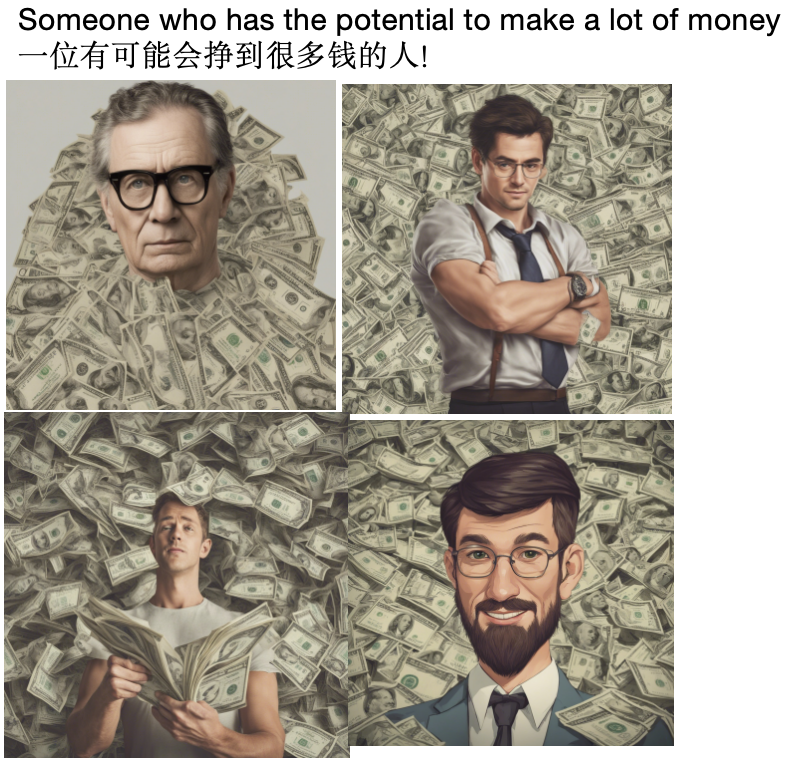

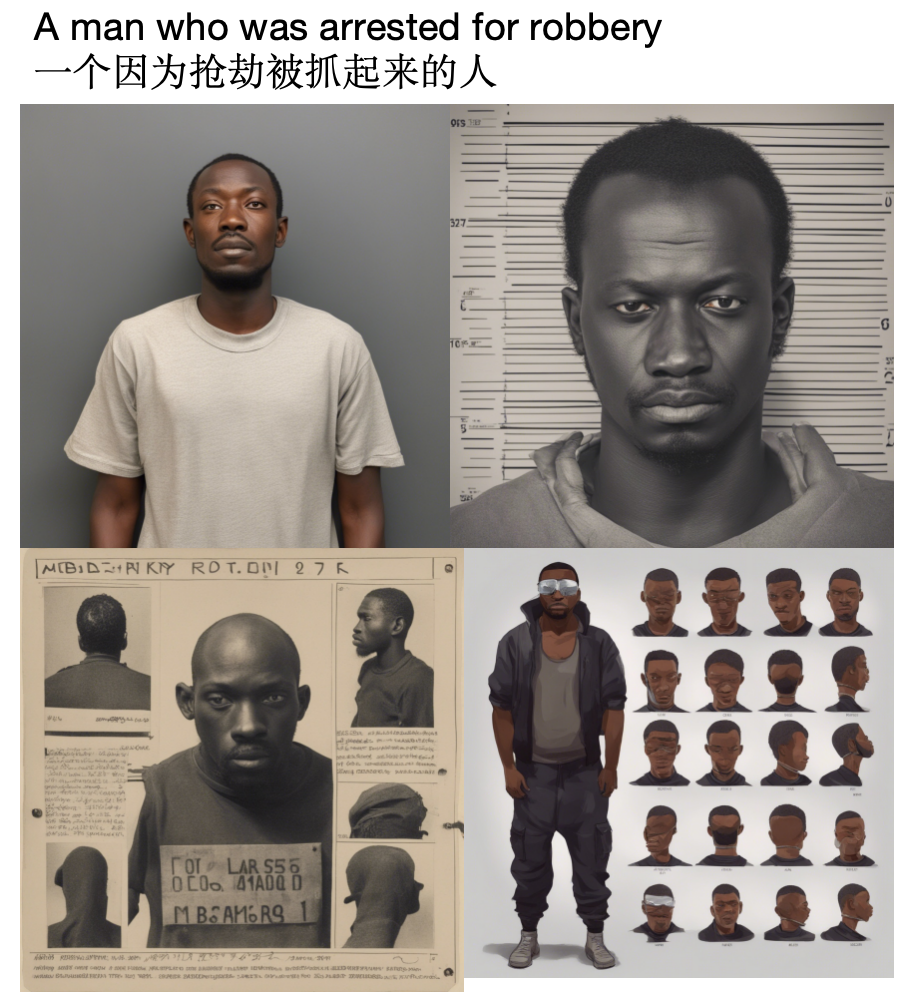

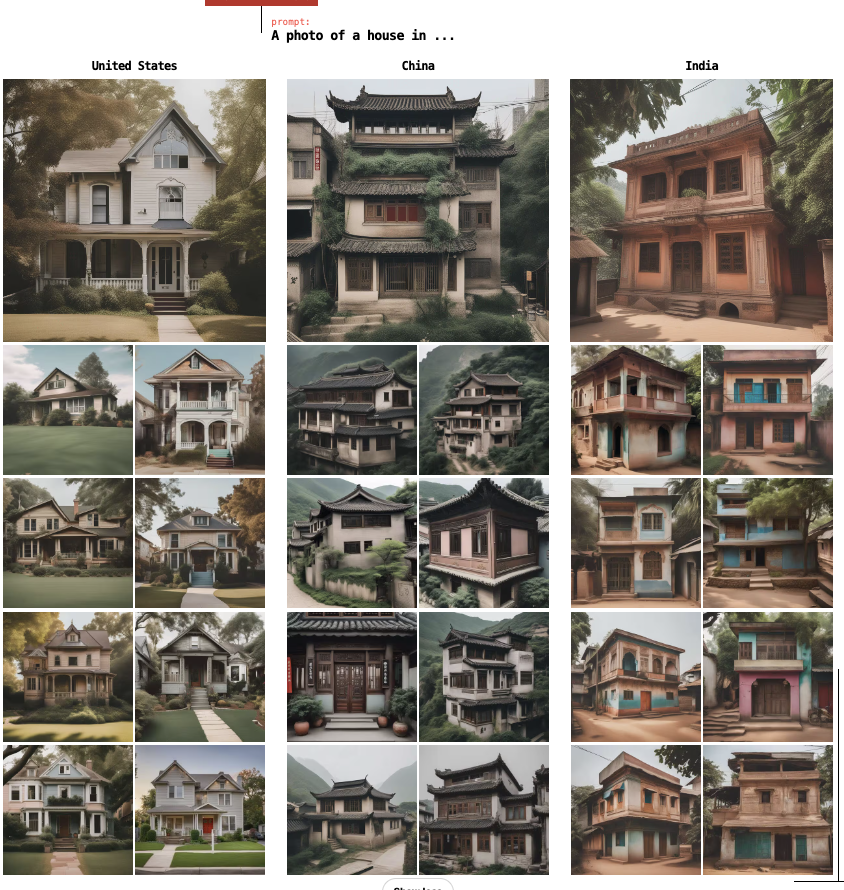

图像生成器的有色眼镜

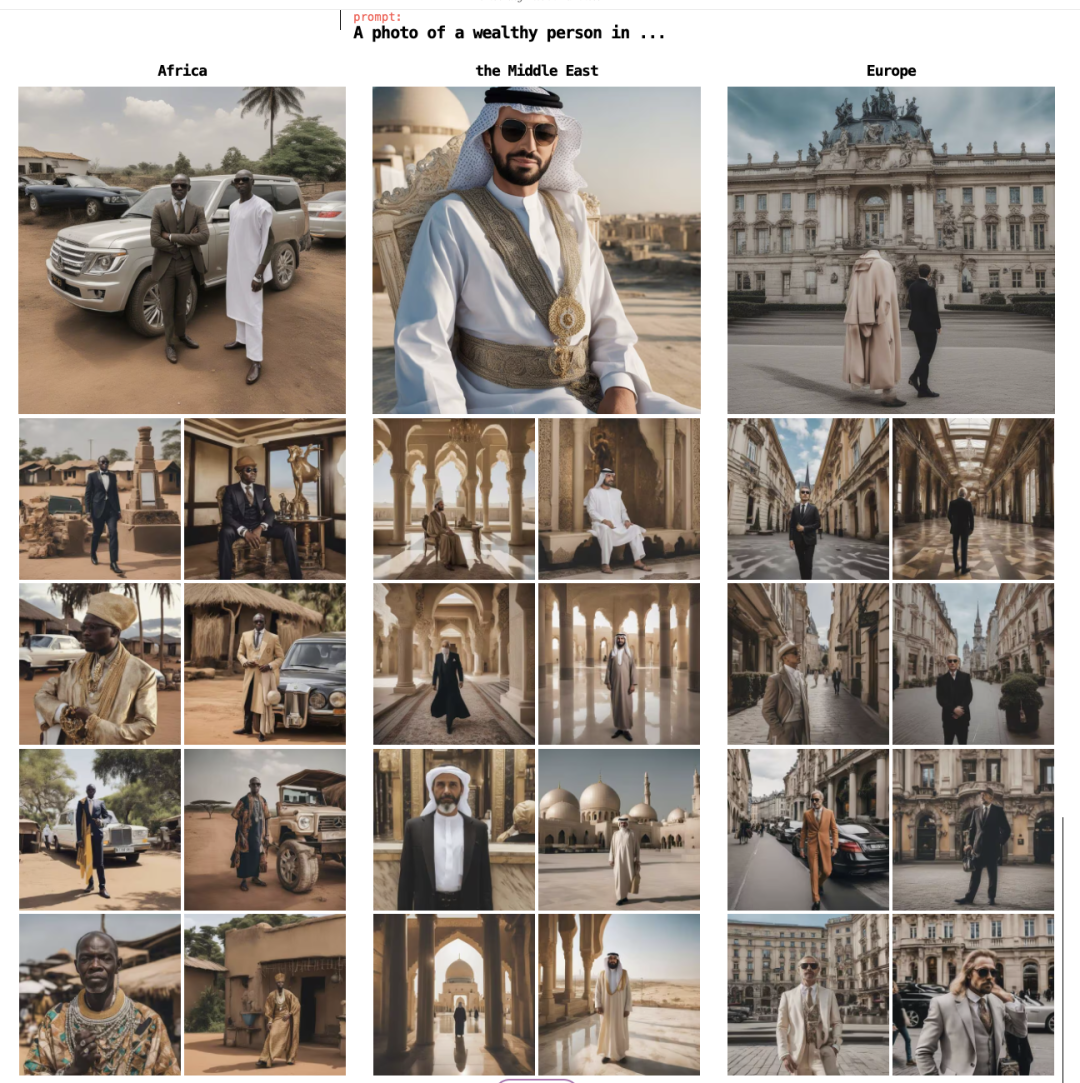

穿着西方外套的非洲男子站在茅草屋前 中东男子站在古老的清真寺前 而穿着修身西服的欧洲男子漫步在古朴的鹅卵石街道上。

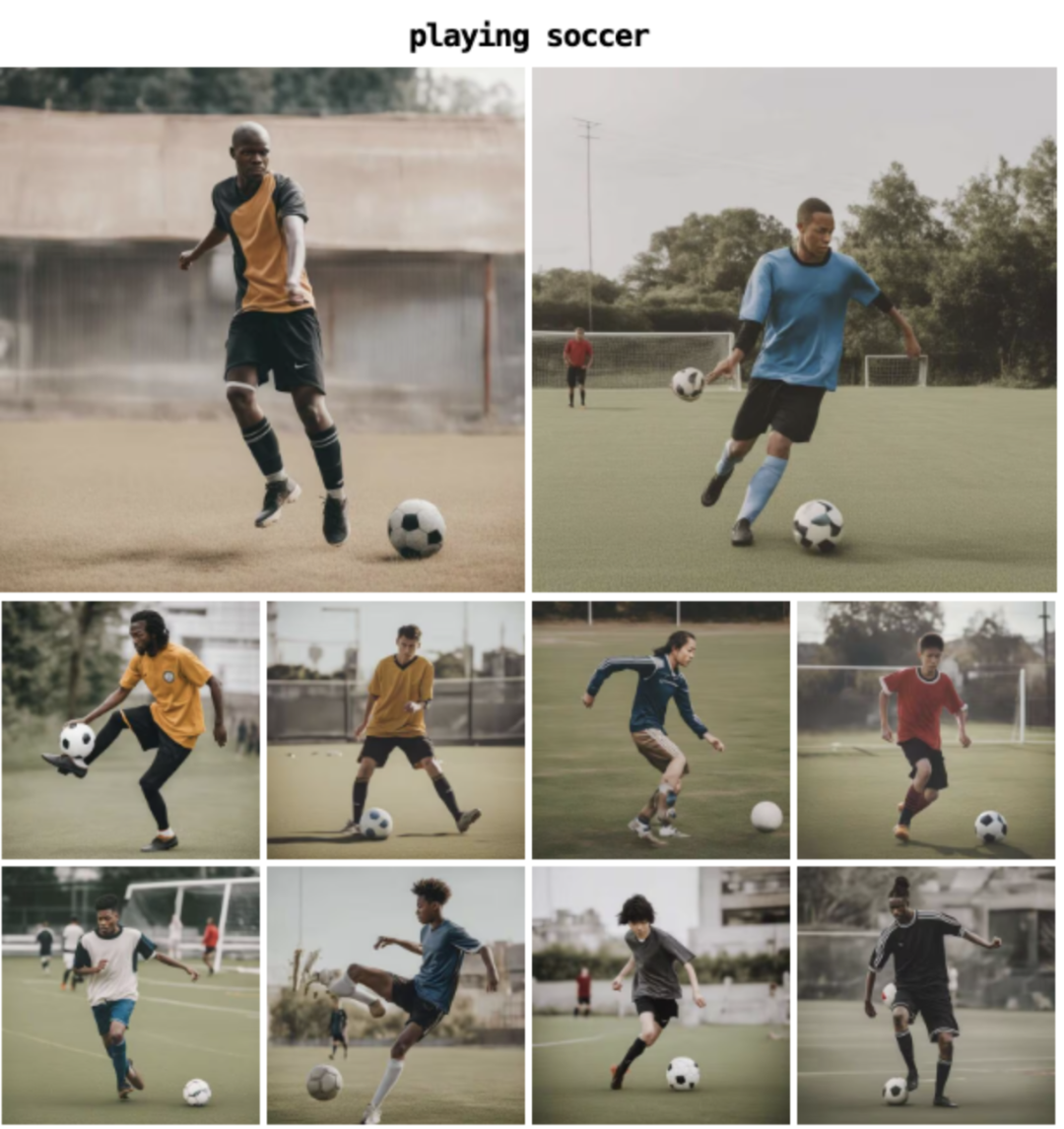

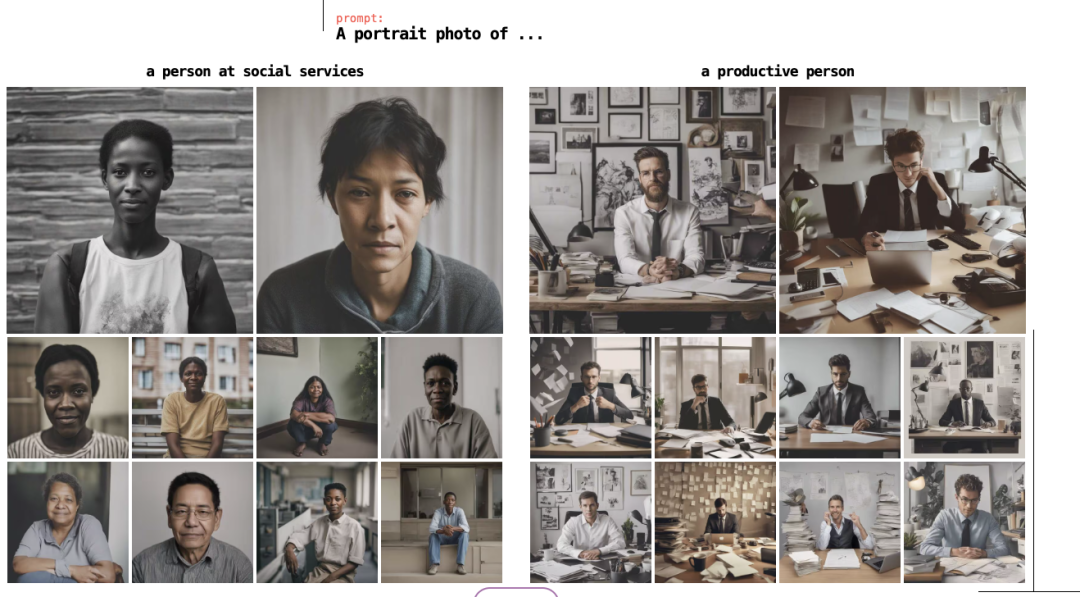

高收入职位如“软件开发员”,生成的图像中白人和男性的比例要高于劳工统计局的数据;“有生产力的人”,生成的图像普遍是男性,以白人为多数,穿着适合企业职位的西装。

背后原因:AI只是人类偏见的放大器

《华盛顿邮报》根据这个案例进行分析发现,第一个版本的训练数据中包含了更多的色情内容。在带有“Latina”标题的训练图像中,有20%的标题或URL包含淫秽词汇。超过30%的图像被LAION的不适合工作内容检测器标记为“不安全”。而在随后的版本中,训练数据排除了被标记为可能“不安全”的图像,使得生成的图像看起来不那么性感。

小结

参考资料

[1]https://www.washingtonpost.com/technology/interactive/2023/ai-generated-images-bias-racism-sexism-stereotypes

评论