你怎么看CV-Transformer【秋招面经分享】

机器学习AI算法工程

共 1928字,需浏览 4分钟

· 2022-07-26

我学习Transformer+CV的论文无非三个步骤:泛读、精读、代码复现。

给大家推荐科研一线——电子羊老师,推出的【CV中的Transformer专题MAE详解直播】,帮你彻底夯实 CV Transformer 基础。

PS:在学习MAE之前需要学习前置知识ViT的结构,输入以及输出。

↓ 前方福利 ↓

现在预约《MAE》直播仅0.1元

扫描👆二维码👆

购买MAE直播后添加小享

免费领取VIT论文讲解视频

23号直播剧透

1.《MAE》简介

1.1研究背景

1.2主要方法

1.3研究成果

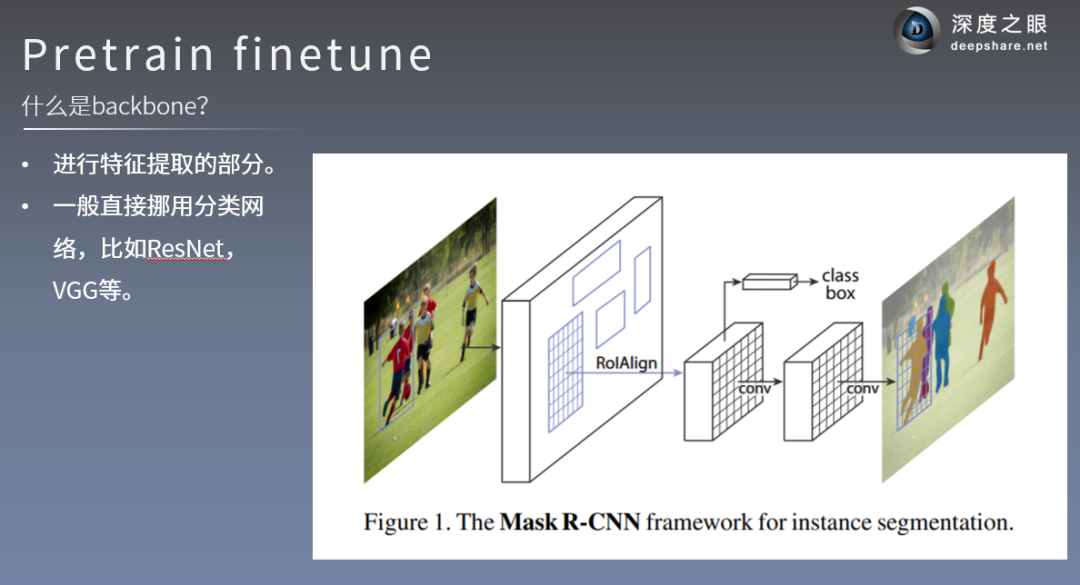

2.Pretrain finetune

2.1什么是backbone?

2.2如何用

2.3一种符合逻辑的推论

3.为什么分类任务如此重要?

3.1特征提取器在做什么

3.2分类模块在做什么

3.3性能和什么有关

3.4如何获得一个好的特征提取器

评论