GAN「一生万物」, ETH、谷歌用单个序列玩转神经动作合成,入选SIGGRAPH

来源:机器之心 本文约2000字,建议阅读5分钟

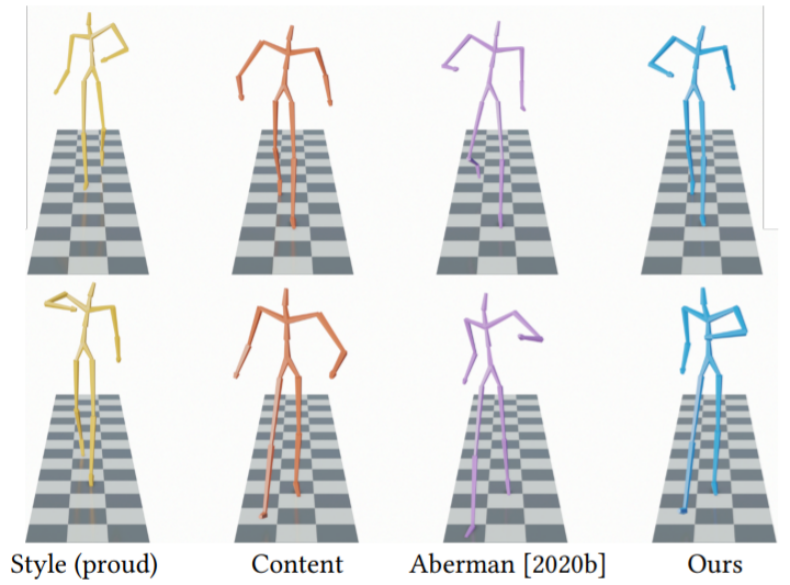

酷炫的神经动作合成技术,单个序列就能完成。

生成逼真且多样化的人体动作是计算机图形学的长期目标。对于动作建模和合成来说,研究者通常使用概率模型来捕获有限的局部变化或利用动作捕捉(mocap)获得的大型动作数据集。在阶段设置(stage-setting)和后期处理(例如,涉及手动数据清理)中,使用动作捕捉系统捕获数据的成本很高,并且动作数据集通常是有限制的,即它们缺乏所需的骨骼结构、身体比例或样式。利用动作数据集通常需要复杂的处理,例如重新定位,这可能会在原始捕获的动作中引入错误。

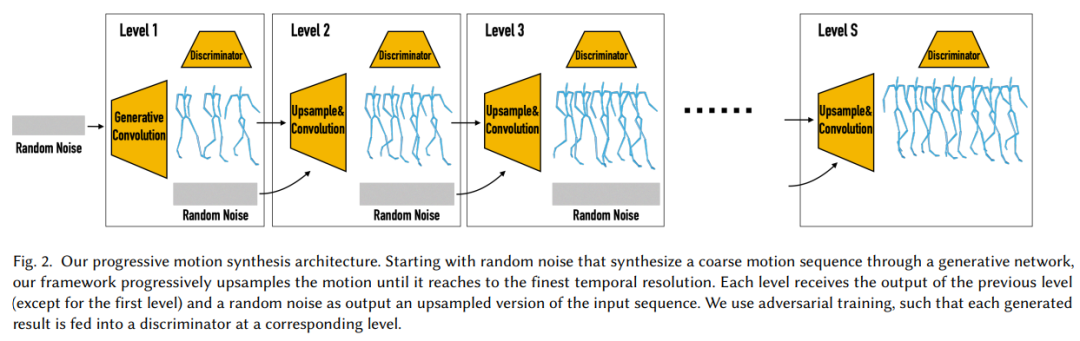

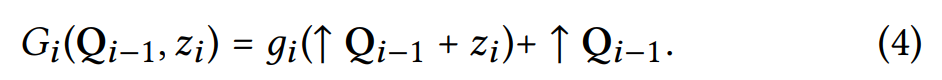

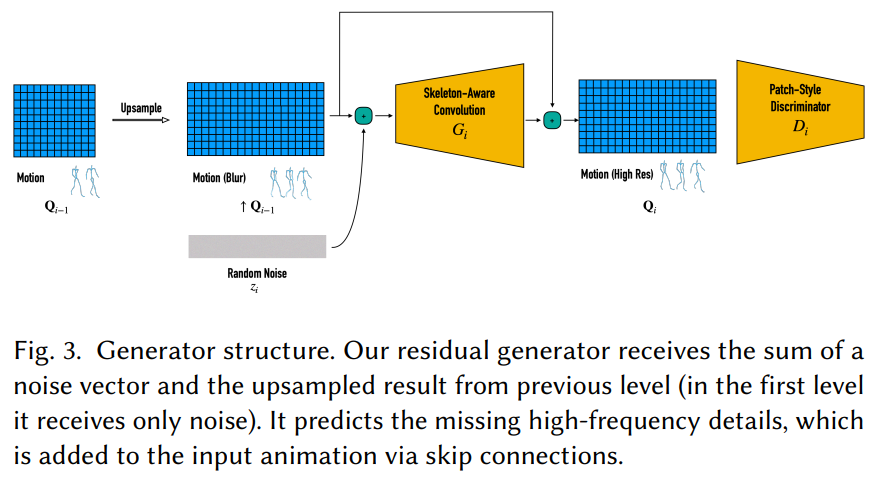

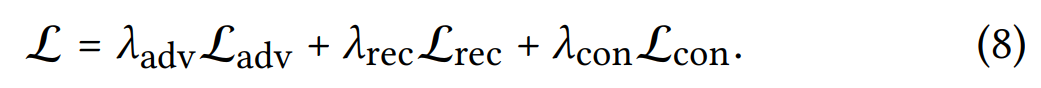

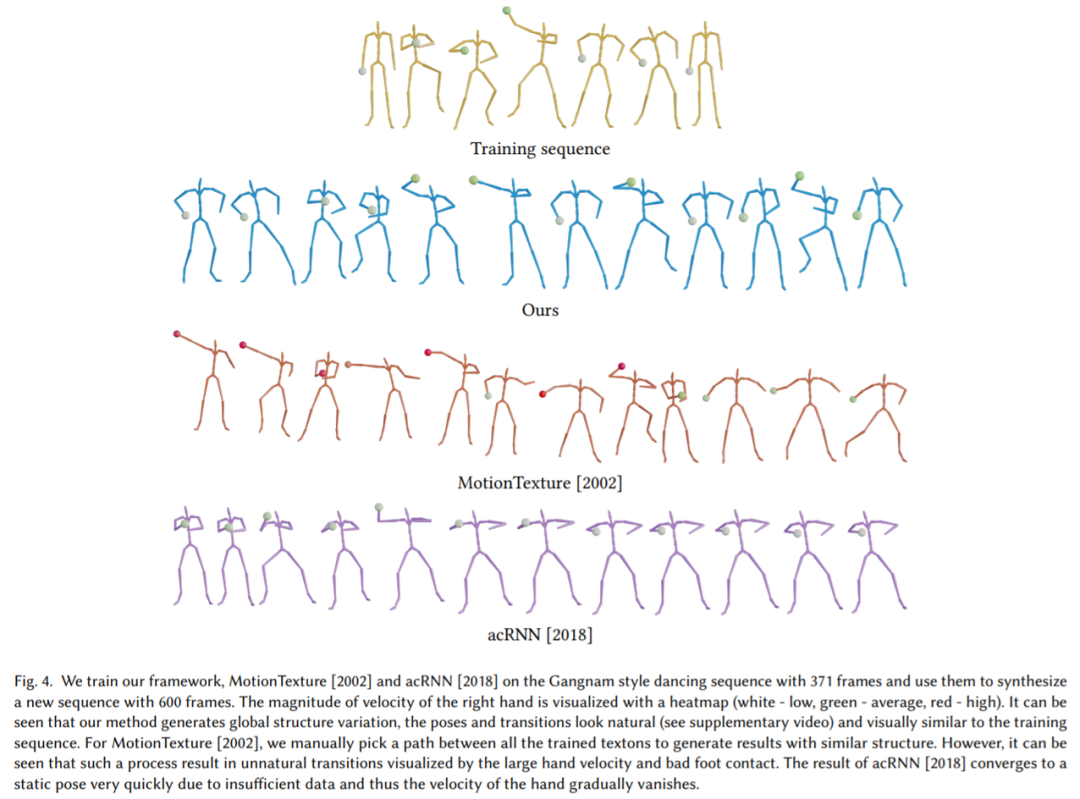

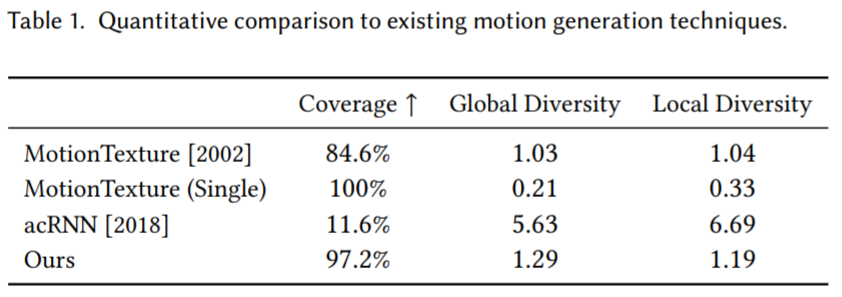

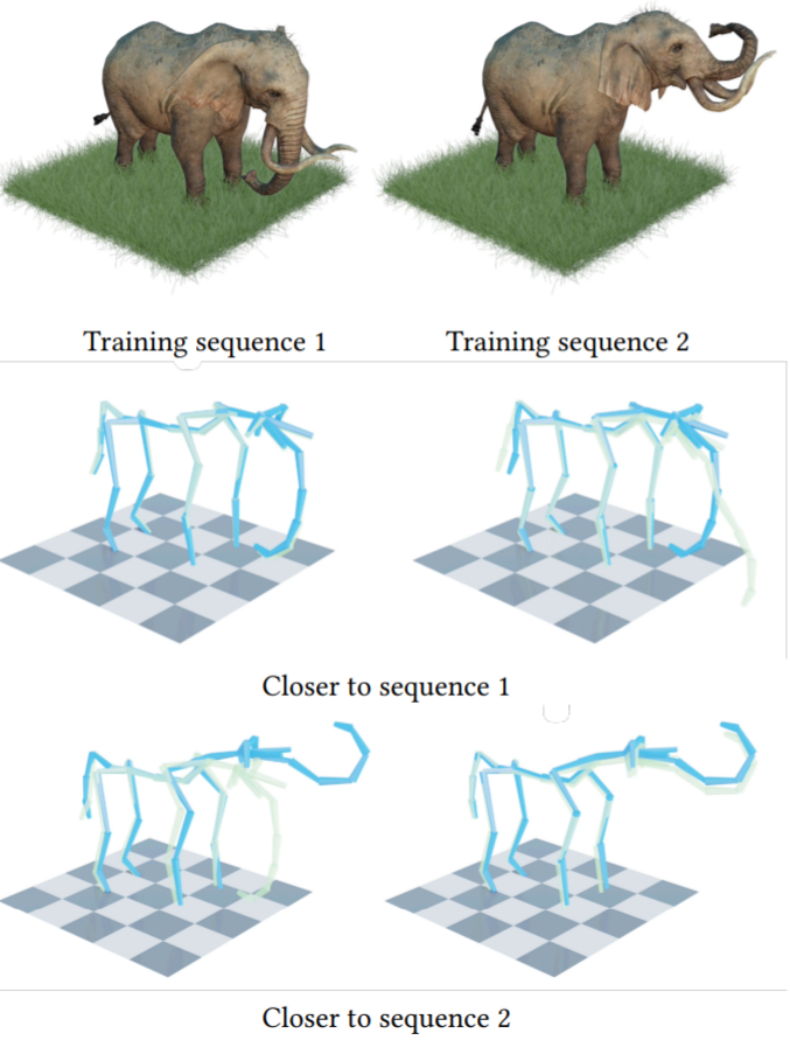

近日,来自苏黎世联邦理工学院、谷歌、芝加哥大学等机构的研究者开发了一个框架 GANimator,该框架能够产生不同且逼真的动作,只使用一个单一的训练序列。这一框架大大简化了数据收集过程,同时允许创建逼真的动作变化,还可以准确地捕捉单独动作序列细节。该研究入选 SIGGRAPH 2022。

论文地址:

https://arxiv.org/pdf/2205.02625.pdf

项目地址: https://peizhuoli.github.io/ganimator/

评论